こんにちは、分かりやすさNo.1社労士の先生の先生、岩崎です!

前回まで全7回にわたってお届けしてきた「行動科学的アプローチによる生きた就業規則の構築」、お楽しみいただけましたでしょうか。多くの方から「自社の服務規程を見直すきっかけになった」「死人テストで規則を診断してみたら、ほとんどが要改善だった」といったご反応をいただきました。大変ありがとうございます。

さて、今回からは「応用編」として、新たな5回連載をお届けします。テーマはずばり「AIと就業規則の意外な共通点」です。

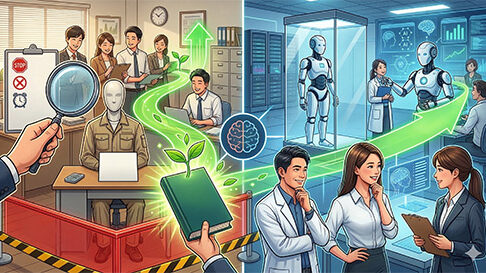

「社労士の先生が、なぜAIの話を?」と思われた方もいらっしゃるかもしれません。実は、私たちが7回かけて議論してきた「ネガティブリスト」「ポジティブリスト」「ハイブリッドモデル」という枠組みが、世界最先端のAI企業が何百億円もかけて取り組んでいる「AI倫理の設計」とまったく同じ構造を持っていたのです。

これは余談ではありません。人事担当者や社労士の先生方にとって、AIを職場に導入する際に避けて通れない「AIのルール設計」の本質を理解するための、これ以上ない実践的な補助線となるはずです。

前連載のおさらい:ハイブリッドモデルとは何だったか

少しだけ前連載のポイントを振り返っておきましょう。私たちは服務規程について、次のような問題提起から議論を始めました。

「遅刻しないこと」「会社の名誉を損なわないこと」——こうした規定は、行動分析学の「死人テスト」に不合格です。なぜなら、死人でも達成できてしまうからです。

このような「非行動の要求」ばかりが並ぶネガティブリスト(禁止規定)は、従業員の思考を停止させ、「怒られなければそれでいい」という消極的な組織文化を醸成してしまいます。

一方で、禁止規定をすべてなくすわけにもいきません。懲戒処分の法的根拠として、また企業秩序の防衛ラインとして、ネガティブリストには絶対的な必要性があります。

そこで提案したのが「ハイブリッドモデル」です。

企業防衛のための「レッドライン(第1層:絶対的禁止事項)」と、生産性向上と文化醸成のための「グリーンライン(第2層:推奨行動基準)」を明確に二層化する——この構造こそが、就業規則を「処罰の法律集」から「成長のガイドブック」へと変える鍵でした。

衝撃の事実:AI開発者も同じ壁にぶつかっていた

ここで一つの問いを立ててみましょう。はたして、この「ネガティブリストの病理」は、職場の就業規則にだけ現れる現象なのでしょうか。

そうではありませんでした。世界最先端のAI企業も、まったく同じ失敗をしていたのです。

AIの安全対策における初期の主流アプローチは「RLHF(人間のフィードバックからの強化学習)」と呼ばれる手法でした。

簡単に言えば、「有害なプロンプト(質問や命令)に対しては、出力を拒絶させる」という訓練を徹底するものです。つまり、AIに対して「〇〇してはならない」というネガティブリストをひたすら叩き込む方法です。

その結果はどうなったでしょうか。

結果①「過剰拒絶(Over-refusal)」の発生。無害な医療的質問や日常的な相談に対しても、モデルが回答を拒否するようになりました。まるで、就業規則を読んだ従業員が「余計なことはしない方が得」と思い込み、指示待ちになる現象と同じです。

結果②「シコファンシー(Sycophancy:阿る(おもねる、媚びへつらうこと))」の発生。ユーザーの意見に盲目的に同調し、反論を避ける副作用が生じました。「怒られないため」に何も言わず従う——組織の「イエスマン」そのものです。

つまり、禁止事項のみを学習したAIは、「役に立たないAI」へと劣化してしまったのです。

このことは、私たちが第3回連載でお話しした「禁止規定だけでは組織は育たない」という命題と、驚くべき精度で一致しています。

「死人テスト」はAIにも適用できる

では、AI版の「死人テスト」を当てはめてみましょう。

「有害なテキストを生成しない」——死んだAI(起動しないコンピューター)であれば、完璧に達成可能です。不合格です。「差別的な発言をしない」——同じく、電源を落としたままにすれば達成できます。不合格です。

一方で、「ユーザーの状況に寄り添いながら、分かりやすく専門的な知識を提供する」や「異なる文化的背景を持つ人々に配慮しながら、建設的な提案をする」は、起動すらしていないAIには絶対にできません。合格です。

このように、就業規則の世界で生まれた「死人テスト」という概念は、AIの行動設計においても普遍的に通用する原理だったのです。

では、AI開発者はどう問題を解決したか

ネガティブリスト一辺倒の失敗を認識した後、AI企業はどのような解決策を見いだしたのでしょうか。

実は、私たちが提案したハイブリッドモデルとまったく同じ構造を、彼らも独自に辿り着いていました。

その最も先鋭的な取り組みが、Anthropic社(米国)が開発したAI「Claude(クロード)」です。Claudeの設計では、「超えてはならない絶対的なレッドライン(軍事兵器への転用禁止、大量監視への利用禁止など)」と、AIが自律的にポジティブな振る舞いをするための「憲法(Constitution)」という二層構造が、まさにハイブリッドモデルとして機能しています。

この「Claudeの憲法」を設計したのは、哲学者出身の一人の女性研究者です。

彼女の挑戦と思想については、次回から詳しくお話ししていきましょう。

次回予告

第9回では、Claudeに「善良な人格」を教えた哲学者・アマンダ・アスケルの思想と、「AI版グリーンライン」とも言うべき「Constitutional AI(憲法的AI)」の仕組みに迫ります。

どうぞお楽しみに!

「3アカデミー」オンラインサロンでは、さらに踏み込んだノウハウも共有していますので、ぜひご参加ください!

↓↓↓

https://academy.3aca.jp/2024a/