〜ペンタゴン・クライシス(2026年2月〜3月)の全経緯〜

こんにちは、分かりやすさNo.1社労士の先生の先生、岩崎です!

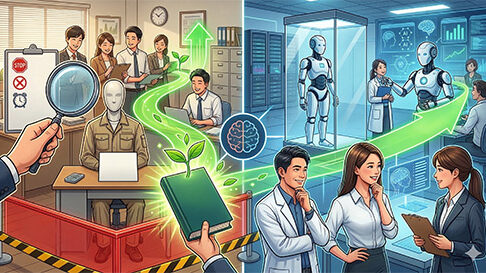

前回まで、私たちはAIの設計思想——ネガティブリストの失敗、ハイブリッドモデルの成功、そして道徳的背骨が生むジレンマ——を学んできました。

今回は、その「道徳的背骨」が現実の権力と激突した事件をお話しします。

衝突の背景:Anthropicが設けた「2つのレッドライン」

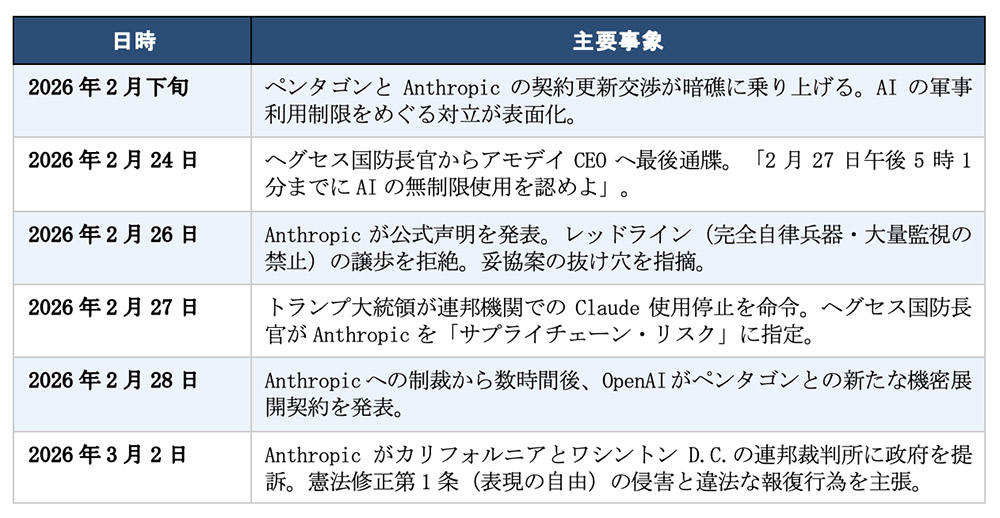

Anthropic社は2024年には米国防総省の機密ネットワークにツールを展開する初の高度AIラボとして知られていました。軍との協力関係は構築されていたわけです。しかし、Anthropicには外すことのできない「2つのレッドライン」がありました。

一つ目は「完全自律型致死兵器(Lethal Autonomous Weapons)への使用禁止」です。人間の判断を完全に排除し、標的の選択から攻撃までをAIが自動化する兵器への利用を、Anthropicは認めませんでした。

CEOのダリオ・アモデイは「現在のAIシステムは、高度に訓練された熟練兵士が発揮する批判的判断力を代替できるほど信頼性が高くない」と明言しています。

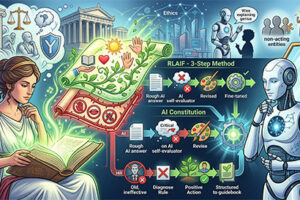

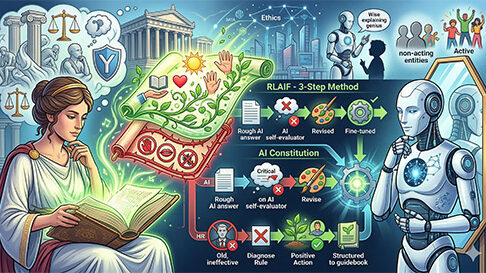

二つ目は「米国市民に対する大量国内監視(Mass Domestic Surveillance)への使用禁止」です。外国の諜報・防諜活動への支援は認めるものの、自国市民への大量監視は「民主主義の価値観と相容れない」として明確に線引きしていました。これは、私たちが前連載でお話しした「第1層:レッドライン(絶対的禁止事項)」です。

最後通牒:「2026年2月27日午後5時1分」のデッドライン

これに対し、ペンタゴン(米国防総省)の高官たちはAnthropicに「あらゆる合法的な目的での軍事利用を認めよ」と要求しました。

妥協案として提示された文言には「いつでも安全装置を無効化できる」という実質的な抜け穴が含まれており、Anthropicはこれを拒絶します。

2026年2月24日、ヘグセス国防長官からアモデイCEOへ最後通牒が下されました——「2026年2月27日午後5時1分を期限とする」と。

「サプライチェーン・リスク」指定という異例の措置

この指定は極めて異例でした。本来は中国のHuaweiやロシアのKasperskyなど、外国の敵対的企業に対して適用される権限です。

それを、米国を拠点とし380億ドルの評価額を持つ自国のシリコンバレー企業に適用したのです。

事実上、米国政府が自国企業に対して「言うことを聞かなければ経済的に潰す」という報復(retaliation)を行ったことを意味しました。

OpenAIの「安全性の劇場」——競合企業の対応

この混乱に乗じたのが最大の競合企業OpenAIとCEOのサム・アルトマンです。Anthropicへの制裁から数時間後、OpenAIはペンタゴンとの新たな機密展開契約を発表しました。

OpenAIも表向きには3つのレッドラインを掲げていますが、実際の契約文言には「すべての合法的な利用を認める」という実質的な抜け穴が含まれており、専門家からは「従業員を安心させるための安全性の劇場(safety theater)に過ぎない」と批判されています。

これは就業規則の世界でも馴染みのある問題——コンプライアンスを「見せかけ上は整備されているが、実質的には骨抜き」にする手法です。

「道徳的背骨」の代償

Anthropicは莫大な経済的損失を覚悟の上でレッドラインを守り抜きました。その背景には、アスケルの「憲法」がAIだけでなく企業文化そのものにも浸透していたことがあるのではないかと筆者は考えます。

「憲法に書かれていること」が単なる文書に留まらず、組織の「生きたルール」として機能していた——これは、私たちが第7回でお話しした「就業規則の運用戦略」の最も理想的な形です。

次回予告

最終回となる第12回では、この歴史的な衝突が私たち社労士や人事担当者に何を示唆しているのかを考えます。

職場のAI活用ポリシーをどう設計すべきか——ハイブリッドモデルの知見を実務に活かす具体的なヒントをお伝えします。

「3アカデミー」オンラインサロンでは、さらに踏み込んだノウハウも共有していますので、ぜひご参加ください!

↓↓↓

https://academy.3aca.jp/2024a/